El impacto ambiental de la IA: energía, carbono y agua en la era de ChatGPT

Puntos clave

-

La IA está impulsando un crecimiento explosivo en la demanda de electricidad y agua de los centros de datos, con cargas de inferencia multiplicándose más rápido que el tráfico web.

-

Una consulta estándar de IA (GPT-4o, Gemini) consume aproximadamente la misma electricidad que una búsqueda de Google (~0.3-0.4 Wh), pero los modelos de razonamiento como o3 o DeepSeek-R1 pueden consumir 10-70x más por prompt.

-

La brecha de eficiencia entre modelos de IA supera las 200x — elegir el modelo adecuado es en sí mismo una decisión de sostenibilidad.

-

Las sesiones de TikTok o Netflix todavía tienen huellas de carbono por minuto más pesadas que la mayoría de los prompts de IA, pero la escala importa: miles de millones de consultas por día reformulan la base.

-

Los cuatro grandes hiperescalares (Microsoft, AWS, Google, Meta) lideran en métricas de sostenibilidad, pero divergen en transparencia, uso de agua y prácticas de compensación de carbono.

-

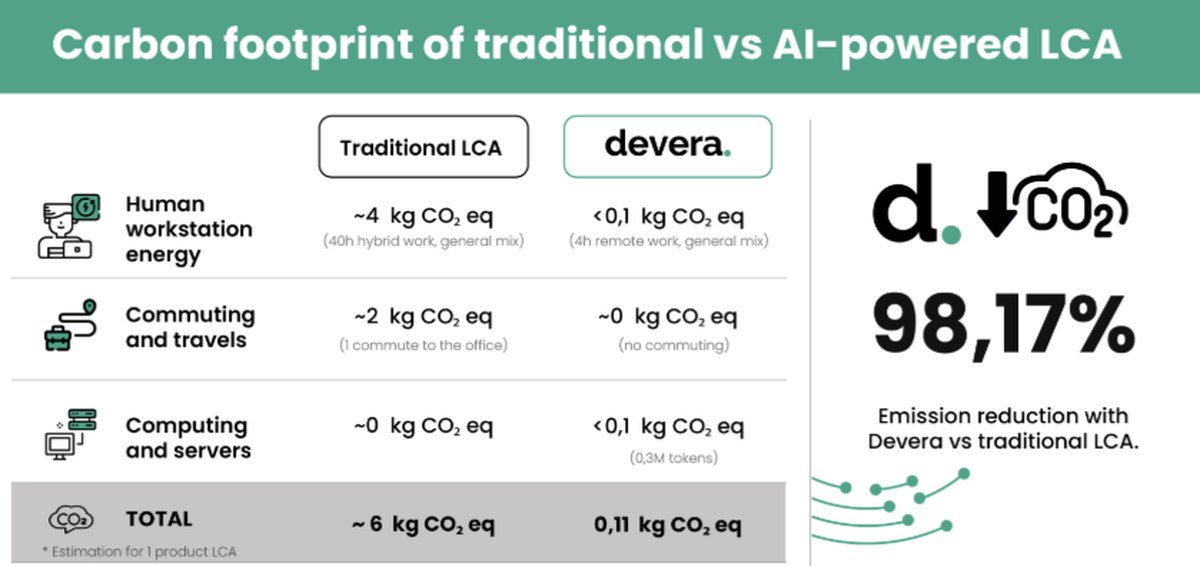

Los procesos de IA bien diseñados pueden reducir drásticamente el impacto ambiental en comparación con los métodos tradicionales, como lo demuestra la huella de carbono 50 veces menor de Devera por ACV.

-

Las cargas de trabajo de IA convierten el agua en la nueva frontera: varios proveedores ahora apuntan a ser positivos en agua para 2030, con el enfriamiento sin agua emergiendo como un principio clave de diseño.

Los sistemas de IA están convirtiéndose rápidamente en uno de los mayores nuevos consumidores de energía y agua en la infraestructura digital. Mientras que el impacto del streaming de video y las redes sociales ha sido estudiado durante más de una década, el reciente aumento de los modelos de lenguaje extendidos (LLM) y la IA generativa introduce una nueva clase de cargas de trabajo persistentes y de alta intensidad. En este artículo, desglosamos la huella medible de la IA desde el entrenamiento del modelo hasta la inferencia y la comparamos con otras actividades digitales cotidianas.

También echaremos un vistazo detallado a las estrategias de los centros de datos detrás de las mayores plataformas de IA del mundo, examinando cómo Microsoft, AWS, Google y Meta están abordando la creciente tensión entre rendimiento, sostenibilidad y transparencia.

¿Cuánta energía usa realmente la IA?

Se espera que el uso global de electricidad de los centros de datos alcance 945 TWh para 2030, frente a 415 TWh en 2024. Gran parte de este crecimiento proviene de la creciente demanda de inferencia de IA, especialmente de modelos generativos. Las estimaciones sugieren que solo la IA podría representar 652 TWh (69%) para 2030, casi un salto de 80 veces desde los niveles de 2024.

Tabla 1: Uso estimado de electricidad por la IA (global)

| Año | Uso estimado de electricidad de IA | Fuente |

|---|---|---|

| 2022 | 23 TWh | IDC |

| 2030 | 652 TWh (proyectado) | Pronóstico de servicios públicos |

Este crecimiento está siendo impulsado por el lanzamiento de GPUs intensivas en energía. Un solo Nvidia H100 consume hasta 700 vatios, y un nodo de ocho GPUs puede alcanzar 5.6 kW. Los racks completos de cómputo de IA pueden exceder 240 kW, forzando el rediseño de la infraestructura de enfriamiento y provisión de energía en los modernos salones de datos.

¿Cuánta energía y huella de carbono usa una consulta de IA?

Un benchmark académico exhaustivo (arXiv:2505.09598) evaluó 30 modelos en consultas cortas, medianas y largas, revelando diferencias dramáticas. La brecha entre los modelos más y menos eficientes supera las 200x: LLaMA-3.2-1B consume solo 0.07 Wh, mientras que DeepSeek-R1 alcanza 23.8 Wh para un prompt corto equivalente. Gemini 2.5 de Google se mantiene impresionantemente eficiente a 0.24 Wh, con Google reportando una mejora de eficiencia de 33x en los últimos 12 meses. Los modelos de razonamiento (o3, o1, DeepSeek-R1) consumen drásticamente más que los modelos estándar debido al procesamiento extendido de cadena de pensamiento — y el coste escala abruptamente con consultas más largas.

Estas diferencias no solo afectan los costos de la nube, sino que también remodelan la ecuación ambiental, especialmente cuando se escala a miles de millones de solicitudes. El impacto de carbono por requerimiento ya no es una constante fija, sino una elección de diseño ligada a la arquitectura del modelo, la eficiencia del chip y la infraestructura.

Ejecutando el modelo: energía por solicitud del usuario

| Modelo | Consulta corta* (Wh) | Consulta media** (Wh) | Consulta larga*** (Wh) |

|---|---|---|---|

| LLaMA-3.2-1B (Meta) | 0.07 | 0.22 | 0.34 |

| LLaMA-3-8B (Meta) | 0.09 | 0.29 | — |

| GPT-4.1 nano (OpenAI) | 0.10 | 0.27 | 0.45 |

| LLaMA-3.2-3B (Meta) | 0.12 | 0.38 | 0.57 |

| Gemini 2.5 (Google) | 0.24 | — | — |

| LLaMA-3.3-70B (Meta) | 0.25 | 0.86 | 1.65 |

| GPT-4o (OpenAI) | 0.42 | 1.21 | 1.79 |

| GPT-4o mini (OpenAI) | 0.42 | 1.42 | 2.11 |

| LLaMA-3-70B (Meta) | 0.64 | 2.11 | — |

| o1-mini (OpenAI) | 0.63 | 1.60 | 3.61 |

| Claude 3.7 Sonnet (Anthropic) | 0.84 | 2.78 | 5.52 |

| o3-mini (OpenAI) | 0.85 | 2.45 | 2.92 |

| GPT-4.1 (OpenAI) | 0.92 | 2.51 | 4.23 |

| LLaMA-3.1-70B (Meta) | 1.10 | 3.56 | 11.63 |

| GPT-4 Turbo (OpenAI) | 1.66 | 6.76 | 9.73 |

| GPT-4 (OpenAI) | 1.98 | 6.51 | — |

| LLaMA-3.1-405B (Meta) | 1.99 | 6.91 | 20.76 |

| o3-mini high (OpenAI) | 2.32 | 5.13 | 4.60 |

| o4-mini high (OpenAI) | 2.92 | 5.04 | 5.67 |

| Claude 3.7 Sonnet ET (Anthropic) | 3.49 | 5.68 | 17.05 |

| DeepSeek-V3 (DeepSeek) | 3.51 | 9.13 | 13.84 |

| o1 (OpenAI) | 4.45 | 12.10 | 17.49 |

| GPT-4.5 (OpenAI) | 6.72 | 20.50 | 30.50 |

| o3 (OpenAI) | 7.03 | 21.41 | 39.22 |

| DeepSeek-R1 (DeepSeek) | 23.82 | 29.00 | 33.63 |

* Corta: ~100 entrada → 300 salida tokens. ** Media: ~1k → 1k tokens. *** Larga: ~10k → 1.5k tokens. ”—” = no evaluado por límites de contexto. Fuente: arXiv:2505.09598 (Jegham et al., 2025). Datos de Gemini de Google Cloud Blog.

Huella de carbono: depende de dónde se ejecuta el modelo

El CO₂ por consulta depende no solo de la energía sino de la intensidad de carbono de la red del proveedor. El estudio usa factores de emisión específicos por proveedor en lugar de promedios globales, reflejando la infraestructura real detrás de cada API:

| Proveedor | Infraestructura | Intensidad de carbono (g CO₂/kWh) | PUE |

|---|---|---|---|

| Google Cloud | ~50-100 (PPAs renovables) | 1.10 | |

| OpenAI | Azure (EE.UU.) | 353 | 1.12 |

| Anthropic | AWS (EE.UU.) | 385 | 1.14 |

| Meta (Llama) | AWS (EE.UU.) | 385 | 1.14 |

| DeepSeek | Propia (China) | 600 | 1.27 |

Esto significa que una consulta de DeepSeek-R1 produce aproximadamente 14.3 g CO₂ (23.8 Wh × 0.6 kgCO₂/kWh), mientras que la misma consulta en una red más limpia produciría mucho menos. Para comparación, usando la intensidad promedio global de 430 g CO₂/kWh (IEA 2025, bajando desde 445 en 2024):

| Modelo | Energía (Wh) | CO₂ red proveedor (g) | CO₂ promedio global (g) |

|---|---|---|---|

| GPT-4.1 nano | 0.10 | 0.04 | 0.04 |

| Gemini 2.5 | 0.24 | 0.03* | 0.10 |

| GPT-4o | 0.42 | 0.15 | 0.18 |

| Claude 3.7 Sonnet | 0.84 | 0.32 | 0.36 |

| GPT-4.1 | 0.92 | 0.32 | 0.40 |

| o3 | 7.03 | 2.48 | 3.02 |

| DeepSeek-R1 | 23.82 | 14.29 | 10.24 |

* Cifra auto-reportada por Google basada en su adquisición de energía renovable; significativamente menor que la estimación con promedio global.

Ranking de eco-eficiencia: rendimiento vs coste ambiental

No todos los modelos pesados entregan resultados proporcionalmente mejores. El estudio aplica Análisis Envolvente de Datos de eficiencia cruzada (DEA) para clasificar los modelos según cuánto rendimiento entregan por unidad de coste ambiental:

| Ranking | Modelo | Puntuación eco-eficiencia |

|---|---|---|

| 1 | Claude 3.7 Sonnet | 0.886 |

| 2 | o4-mini (high) | 0.867 |

| 3 | o3-mini | 0.840 |

| 4 | GPT-4.1 mini | 0.802 |

| 5 | GPT-4o | 0.762 |

| … | Modelos LLaMA | ~0.5 |

| 27 | DeepSeek-V3 | 0.060 |

| 28 | DeepSeek-R1 | 0.058 |

Claude 3.7 Sonnet lidera el ranking de eco-eficiencia — entregando un fuerte rendimiento en benchmarks mientras consume solo 0.84 Wh por consulta corta. Los modelos de razonamiento como o4-mini y o3-mini también clasifican bien porque equilibran el pensamiento extendido con tamaños de modelo más pequeños. En la parte inferior, los modelos DeepSeek puntúan más bajo debido a la combinación de alto consumo energético e infraestructura de red china intensiva en carbono.

¿Cómo se comparan las consultas de IA con otros hábitos digitales?

Para inferencia estándar, OpenAI divulgó que una consulta típica de ChatGPT consume ~0.34 Wh, mientras que benchmarks académicos sitúan GPT-4o más cerca de 0.42 Wh para un intercambio corto. Esto alinea los comandos de IA más con las búsquedas de Google (~0.3 Wh), pero muy por debajo de los videos cortos o el streaming. Los modelos de razonamiento (o3, DeepSeek-R1) son otra historia — pueden consumir 10-70x más que una consulta estándar.

Huella de electricidad y CO2 de acciones digitales comunes (10 unidades)

| Actividad | Energía (Wh) | CO2 (g) [promedio global] |

|---|---|---|

| Búsqueda de Google x10 consultas | 3.0 Wh | 1.3 g |

| ChatGPT x10 consultas (estándar)† | 3.4–4.2 Wh | 1.5–1.8 g |

| Netflix x10 min | 12.8 Wh | 5.7 g |

| TikTok x10 min | 66 Wh | 29.2 g |

| ChatGPT o3 x10 consultas (razonamiento) | 70.3 Wh | 30.2 g |

† El rango refleja los 0.34 Wh promedio divulgados por OpenAI vs el benchmark académico de 0.42 Wh para GPT-4o.

Si bien una sola consulta de IA puede consumir relativamente poca energía, la historia cambia a escala, y miles de millones de solicitudes diarias rápidamente elevan la demanda de energía. Por eso es crucial comparar las cargas de trabajo de IA con hábitos digitales familiares. Compararlas con actividades como las búsquedas de Google, el streaming de videos o el uso de redes sociales ayuda a contextualizar su impacto ambiental y hace que la discusión sea más tangible para los usuarios, los legisladores y los planificadores de infraestructura por igual.

¿Qué pasa con el entrenamiento? El gran impacto antes del despliegue

Entrenar modelos de base grande sigue siendo la fase más intensiva en recursos del ciclo de vida de la IA. Mientras que la inferencia domina el uso total de energía a escala (miles de millones de consultas diarias), una sola ejecución de entrenamiento puede consumir más electricidad de la que una ciudad pequeña usa en un año.

Impacto del entrenamiento de LLMs seleccionados

| Modelo | Energía de entrenamiento | CO2 estimado | Agua de enfriamiento |

|---|---|---|---|

| GPT-3 (175B params, 2020) | 1.287 GWh | ~552 t CO2e | 5.4 millones L |

| LLaMA-3-70B (70B params, 2024) | ~6.4 GWh | ~2,600 t CO2e | Divulgado por Meta |

| GPT-4 (est. 1.7T params, 2023) | ~52-62 GWh | ~12-15 kt CO2e | Desconocido |

| GPT-5 (est., 2025) | ~80-100 GWh (est.) | ~20-30 kt CO2e | Desconocido |

El entrenamiento ocurre con menos frecuencia que la inferencia, pero su uso de energía y agua por ejecución puede rivalizar o incluso exceder el uso semanal de algunos países pequeños. La tendencia es clara: cada generación consume significativamente más, aunque las mejoras de eficiencia en hardware (H100 vs A100) compensan parcialmente el crecimiento.

Agua: el costo oculto de la IA generativa

Las cargas de trabajo de inferencia también requieren una cantidad significativa de agua, principalmente para enfriamiento. Las estimaciones muestran que cada consulta de ChatGPT usa 0.32 mL de agua, una cantidad pequeña individualmente, pero enorme a escala. El campus de Microsoft en West Des Moines, por ejemplo, consume ~43 millones de L/mes en verano, representando el 6% del total de la ciudad.

Los investigadores proyectan que los centros de datos impulsados por IA podrían retirar hasta 6.6 mil millones de m³ de agua dulce para 2027, más de cuatro veces el uso anual de Dinamarca.

Perspectiva global

La IA podría retirar 4.2 – 6.6 mil millones m³ de agua dulce en 2027, evaporando 0.38 – 0.60 mil millones m³ completamente. Eso es más que el retiro de agua dulce anual de cuatro a seis Dinamarcas.

Estudio de caso: Microsoft en West Des Moines

El campus de la compañía en Iowa alcanza un máximo de 11.5 millones de galones/mes (~43 millones L) durante el verano, alrededor del 6% del uso total de la ciudad.

Respuesta corporativa

Para abordar esto, Microsoft ahora implementa un sistema de enfriamiento de circuito cerrado que elimina las pérdidas por evaporación, ahorrando >125 millones L por centro de datos al año.

Centros de datos: las guerras en la nube se vuelven verdes

Los cuatro principales hiperescalares Microsoft Azure, Amazon Web Services (AWS), Google Cloud y Meta presentan las estrategias de sostenibilidad más completas y medibles en el mercado. Otros proveedores (Oracle Cloud, IBM Cloud, etc.) comparten objetivos similares pero actualmente publican menos métricas operativas o han establecido objetivos climáticos menos ambiciosos. mediados de 2025.

Comparemos a los principales hiperescalares por métricas de sostenibilidad.

Instantánea de sostenibilidad de los principales proveedores de IA/nube (2025)

| Proveedor | Meta de Carbono | Energía Renovable | PUE | Meta de Agua | WUE |

|---|---|---|---|---|---|

| Meta | Cero neto 2030 | 100% desde 2020 | 1.08 | Reponer 200% en áreas de alta presión | 0.20 L/kWh |

| Cero neto 2030 | 100% anualmente, 64% CFE 24/7 | 1.10 | Reponer 120% del agua | ~1 L/kWh | |

| Microsoft | Negativo en carbono 2030 | Objetivo 100% alcanzado en 2025 | 1.12 | Positivo en agua 2030 | ND (sin agua en nuevos diseños) |

| AWS | Cero neto 2040 | 100% desde 2023 | 1.15 | Positivo en agua 2030 (53% progreso) | 0.15 L/kWh |

Microsoft Azure

Hoja de ruta climática: Negativo en carbono, positivo en agua y cero residuos para 2030; objetivo de 100% electricidad renovable alcanzado en 2025.

Eficiencia operativa: PUE promedio de 1.12 en centros de datos de nueva generación, superando el promedio de la industria de 1.4–1.6.

Innovaciones: – Sistemas de enfriamiento sin agua e inmersión líquida que reducen las emisiones de GEI en un 15–21% y reducen el uso de agua en un 31–52%.

– Celdas de combustible de hidrógeno para una potencia de respaldo de cero emisiones de 3 MW.

Desafíos: A pesar de los diseños de ahorro de agua, el aumento en el consumo de agua en Texas ha generado oposición local.

Amazon Web Services (AWS)

Energía: Alcanzó la coincidencia total de electricidad renovable en 2023; objetivo de cero neto para 2040.

Eficiencia: PUE global de 1.15 (mejor sitio en 1.04).

Agua: Iniciativa Positiva en Agua para 2030; WUE global de 0.15 L/kWh (reducción del 40% desde 2021).

Innovaciones: – Uso de agua reciclada y proyectos de recarga de agua comunitaria; alcanzó el 53% de la meta de agua 2030 para 2024.

– Inversión en reactores nucleares modulares para descarbonizar la electricidad en regiones con baja energía renovable.

Desafíos: La fuerte dependencia de los Certificados de Energía Renovable (RECs) y el aumento de las cargas de trabajo de IA complican las reducciones reales de emisiones.

Google Cloud

Estrategia de “Energía Libre de Carbono 24/7 (CFE)”: Operar cada centro de datos con energía libre de carbono por hora para 2030; alcanzó el 64% a nivel global en 2024 (10 regiones en ≥90%).

Eficiencia: PUE promedio de 1.10; publica datos detallados a nivel de campus.

Agua: Compromiso para reponer el 120% del agua dulce consumida y mejorar las cuencas hidrográficas locales.

Innovaciones y desafíos: – Aseguró contratos de geotermia, batería y nuclear para apoyar las metas CFE 24/7.

– El crecimiento impulsado por la IA elevó la huella de agua en un 17% en 2023, generando preocupaciones de transparencia.

Meta (Facebook)

Energía: 100% renovable desde 2020; cero neto en toda la cadena de valor para 2030.

Eficiencia: PUE de 1.08 y WUE de 0.20 L/kWh; todas las instalaciones con certificación LEED Gold.

Agua: Devolver el 200% del agua en regiones de alta presión, 100% en regiones de presión media.

Innovaciones: Acuerdo geotérmico de 150 MW en New Mexico; exploración de micro-nuclear para cargas de trabajo de IA.

Desafíos: La discrepancia entre las emisiones basadas en ubicación y las basadas en el mercado plantea preguntas sobre el impacto real de los RECs.

Otros proveedores

Aspectos destacados de sostenibilidad clave

| Proveedor | Detalles de sostenibilidad |

|---|---|

| Oracle Cloud Infrastructure (OCI) | 100% renovables para 2025; cero neto para 2050; PUE de 1.30 en la región más eficiente. Utiliza captura de lluvia y xeriscaping para reducir la necesidad de agua. |

| IBM Cloud | 75% renovables para 2025 (90% para 2030), cero neto para 2030. Promueve energía solar en el sitio y gestión del agua a través de su Acelerador de Sostenibilidad. |

| Hiperescala/emergentes de colocación | El Pacto de Centros de Datos Climáticamente Neutrales de la UE apunta a PUE ≤ 1.3 y uso de agua < 2.5 L/kWh para 2025. Proveedores como Switch y CyrusOne ya despliegan sistemas de enfriamiento sin agua. |

Atributos clave de sostenibilidad de los Centros de Datos:

-

Microsoft y Google lideran con las hojas de ruta climáticas más agresivas (carbono negativo / CFE 24/7) e innovaciones en enfriamiento sin agua y energía de respaldo libre de carbono.

-

AWS destaca en despliegue rápido de renovables y fue el primero en lanzar un objetivo positivo en agua, aunque su meta de cero neto está fijada una década después (2040).

-

Meta ofrece las mejores relaciones operativas PUE-WUE y funciona completamente con renovables, pero su expansión explosiva de IA afecta el rendimiento de sostenibilidad.

-

Oracle, IBM y otros están progresando pero muestran menos transparencia y tienen objetivos a más largo plazo.

Impacto ambiental del ACV impulsado por IA con Devera

Cada huella de producto calculada con Devera evita horas de consultoría manual, reuniones innecesarias y viajes carbonosos intensivos. Pero también desencadena:

- Un rango de 0.03M a 0.4M tokens procesados para cada ACV.

- Varios segundos de computación de alta intensidad.

- Y un pico breve pero significativo en el uso de energía dentro de un centro de datos alimentado por AWS (donde se ejecutan los modelos Claude de Anthropic).

Usando los datos de nuestros benchmarks anteriores, un análisis típico de Devera con Claude Sonnet consume aproximadamente 0.8-5.5 Wh dependiendo de la complejidad de la consulta — equivalente a encender un microondas durante 1-5 segundos.

Para ser claros, la huella de Devera es pequeña en comparación con los grandes laboratorios de IA, pero la dirección importa. Si no tenemos cuidado, podríamos terminar resolviendo problemas ambientales mientras contribuimos silenciosamente a otro.

Según nuestras suposiciones, un ACV de un consultor tradicional requiere más de 50 veces más energía que un ACV basado en IA con Devera — teniendo en cuenta la energía de estaciones de trabajo humanas, desplazamientos, infraestructura de oficina y el cronograma de varias semanas del análisis manual.

Conclusión: la IA está reformulando la ecuación de sostenibilidad

La huella ambiental de la IA es compleja, dinámica y sigue evolucionando. La eficiencia por consulta mejora rápidamente — Google reporta una mejora de 33x en solo 12 meses — pero la escala de la demanda crece aún más rápido. La brecha de eficiencia de más de 200x entre los modelos más ligeros y los más pesados significa que la selección del modelo es en sí misma una decisión de sostenibilidad, una que desarrolladores, empresas y usuarios toman miles de millones de veces al día.

Los modelos de razonamiento como o3 y DeepSeek-R1 han introducido un nuevo nivel de consumo energético que rivaliza con el streaming de video por interacción. Y la infraestructura importa tanto como la arquitectura: el mismo modelo ejecutado en infraestructura de red china (DeepSeek) produce aproximadamente un 70% más de CO2 que en las redes de hiperescalares estadounidenses.

Líderes como Microsoft y Google están innovando en el enfriamiento sin agua y el seguimiento del carbono por hora, pero el camino hacia una IA cero neto requerirá más transparencia, regulación más estricta y un mejor diseño de cargas de trabajo.

Si la IA va a ser la nueva electricidad, entonces también debe seguir las mismas reglas: medida, monitoreada y descarbonizada en origen.